沈江霖, 魏 丹, 王子阳

(上海工程技术大学机械与汽车工程学院, 上海 201620)

在无人驾驶中,通过对行人下一步动作的预测可以提前完成汽车加速或者减速的决策,同时可以减小事故发生的概率[1]。如果不能准确的预测行人的下一步动作,人车系统安全将无从谈起。CHEN等[2]提出了一种用于动作预测的循环语义保留生成方法,开发了一个生成体系结构补充骨架序列用于预测动作,该方法未考虑行人部位遮挡及背景干扰问题。LI等[3]研究了基于骨架数据的动作预测,提出了一种基于对抗学习的自适应图卷积网络,学习局部序列中潜在的全局信息,该网络对行人姿态变化和外观差异等因素不具有鲁棒性。针对上述问题,本文提出一种新的基于网格划分骨骼的行为预测方法,通过对行人进行网格划分并提取相应关节点的行为特征,对比前后帧的行为特征,进而判断行人的运动方向及运动速度。

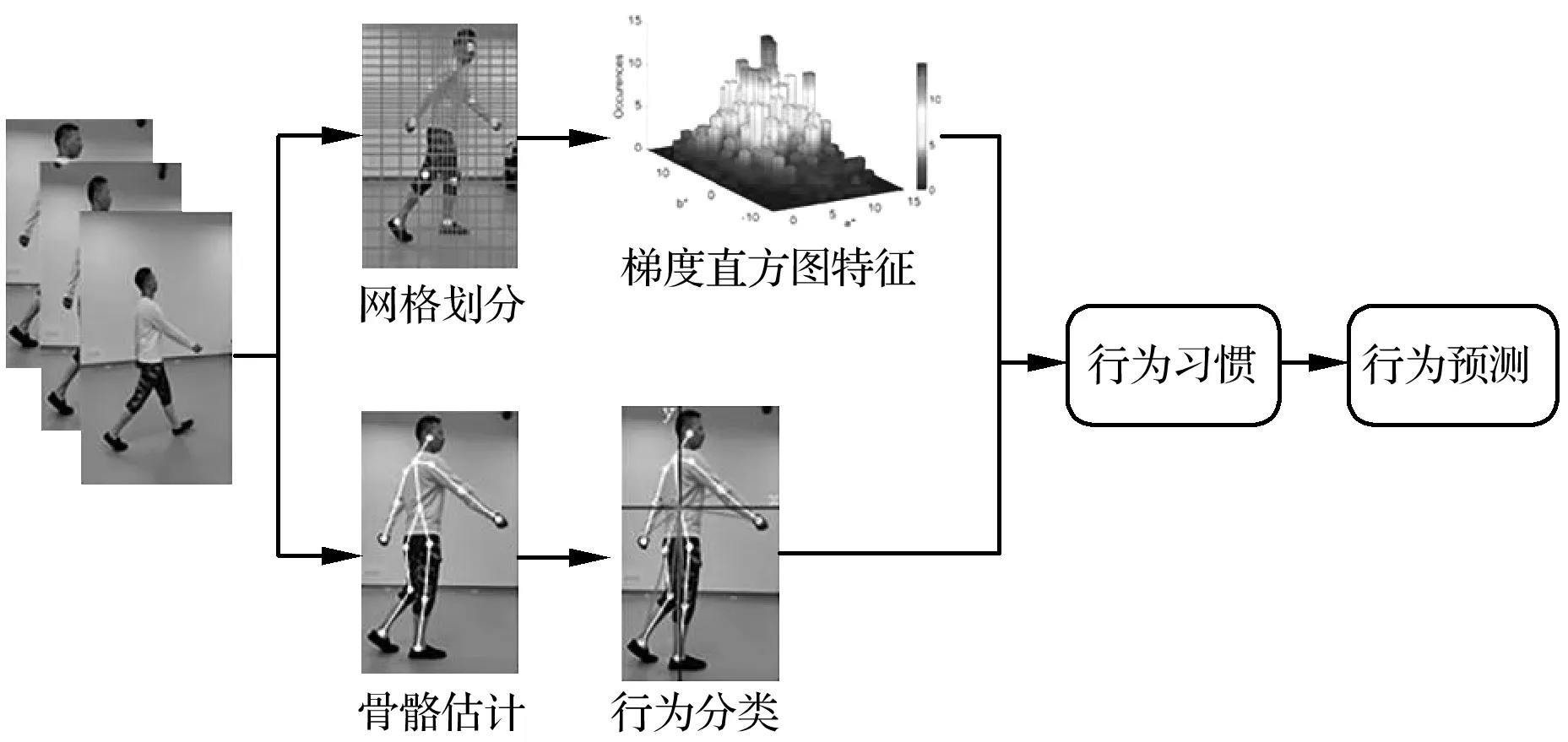

基于网格划分骨骼的行为预测方法主要分为两个部分:行人网格划分和行人骨骼行为特征提取。具体来说,就是将行人进行网格划分和对行人骨骼进行估计,提取出网格特征、关节点角度及骨骼特征,将三者结合形成行人的行为动作特征,通过前后帧的对比,计算下一帧行人动作发生的概率。基于网格划分骨骼的行为预测方法的流程如图1所示。

图1 基于网格划分骨骼的行为预测方法的流程图Fig.1 Flow chart of action prediction method based on grid partition of skeleton

给定一个测试视频,初始化其定位算法,在单帧中使用自下而上的骨骼估计,并使用之前帧的多个时空约束细化位姿。本文将测试视频帧进行密集网格划分,利用每个划分网格内计算的特征,学习1个基于划分网格的外观模型,该模型通过训练1个在每个位姿边界框内的网格特征作为前景,其余划分的网格特征作为背景的判别分类器,区分前景和背景。同时,由于骨骼关节点角度和前一帧骨骼关节点角度是一致的,基于此可以计算当前时间步长姿态假设的条件概率。将每个时间步长的概率结果结合后,通过在关节点位置、行人外观及姿势比例上施加一致性改进姿势。

一旦在当前的时间步长中估计并改进了姿势,就会更新基于网格特征的外观模型,以避免出现视觉漂移。因此,骨骼估计不但提供了初始化具有判别力的外观模型,而且可以包含任何行人全身或多个关节点的交互或执行操作。

本文采取文献[4]中介绍的自下而上的方法进行行人骨架估计,行人骨架估计结果如图2左部分和图3左部分所示。行人骨架估计完成后,本文将骨架特征单独提取出来,如图2右部分和图3右部分所示,并规定了8个关节点作为行为角度特征的基点,分别为左右肘关节点(A,a,C,c)、左右手关节点(B,b,D,d)、左右膝关节点(E,e,I,i)、左右脚关节点(F,f,J,j)。本文通过网格划分得到的网格中心o作为二维坐标系的原点,以o为原点学习8个关节点到原点的距离度量特征和角度度量特征。通过与前一帧的距离度量特征和角度度量特征进行对比,判断各个关节点的变化趋势。

图2 前一帧行人骨骼估计及其角度特征Fig.2 Pedestrian skeleton estimation and its angle characteristics in the previous frame

图3 后一帧行人骨骼估计及其角度特征Fig.3 Post-frame pedestrian skeleton estimation and its angular characteristics

当行人行走时,o点与头部、肩部和胯部相应关节点的距离度量和角度度量变化不大,不能体现行人的姿态变化,更无法通过o点与头部、肩部和胯部相应关节点的距离度量和角度度量预测行人下一帧的动作变化。与头部、肩部和胯部相应的关节点不同的是,行人行走时的左右肘关节点、左右手关节点、左右膝关节点、左右脚关节点与o点的距离度量和角度度量变化幅度很大;而且行人行走时,手臂的摆幅、跨步的距离都是行人行走习惯的表现,通过对左右肘关节点、左右手关节点、左右膝关节点、左右脚关节点与o点的距离度量和角度度量的学习,可以得到行人的行走习惯,从而判断下一帧行人的动作变化。

不同帧捕捉到行人的左右肘关节点、左右手关节点、左右膝关节点和左右脚关节点的距离度量特征和角度度量特征不同,通过对比前后帧的距离度量特征和角度度量特征计算出下一帧关节点的运动类型发生概率。本文利用公式(1)计算出关节点的距离度量特征doi:

doi=xTMx

(1)

本文定义的行为特征包括距离度量特征和角度度量特征,由于关节点与原点o的角度不易计算,因此本文利用关节点角度的正弦值表示关节点的角度。本文利用公式(2)计算角度度量特征θi:

(2)

行人行为特征的距离度量特征doi和角度度量特征θi都是基于相同关节点计算得出,两者具有相关性。本文利用公式(3)计算出两者的关联度τi:

(3)

其中,ρ为分辨系数,一般ρ=0.5。通过关联度τi将两个特征关联后得到行人的行为特征Ti,行为特征Ti可以用公式(4)表示:

Ti=sinθi+τidoi

(4)

计算出行人行为特征后,利用公式(5)计算下一帧该关节点的运动特征出现概率:

(5)

利用上述公式计算出8个关节点下一帧运动类型的概率,然后结合8个关节点下一帧的运动类型判断下一帧行人动作。为了更准确地判断行人运动,本文将行人划分为无数密集网格,结果如图4所示,通过提取划分网格的特征,对比前后帧的8个关节点的网格特征变化,判断行人前进或者后退,以及行动加速、匀速或者减速。以上判断都是基于MATLAB代码实现的。

3.1 数据集

在3个行为动作预测数据集sub-JHMDB、UCF-Sports和MSR-II上对本文所提方法进行验证。

sub-JHMDB数据集[5]的每帧都可以看到所有人体关节,共包含316个视频、12个动作类。考虑到行人关节的复杂变化,每一帧行人的识别和定位变得极具挑战性,故在JHMDB数据集基础上,使用sub-JHMDB数据集。

UCF-Sports数据集[6-7]包含150个视频和10个动作类。使用文献[8]提出的方法对本文所提方法进行评估。

MSR-II数据集[9]包含54个未修剪的视频和3个动作类。本文采用跨数据集估值,并使用KTH数据集对MSR-II数据集进行训练和测试。在数据集iDTFs使用大小为K=1 000的码数训练支持向量机。本文使用精确回忆曲线和最先进的离线方法进行定量比较,同时为了与其他数据集保持一致,本文也使用受试者工作特征曲线(Receiver Operating Characteristic, ROC)和ROC曲线下面区域的面积(Area Under Curve, AUC)报告结果。

3.2 实验设置

受早期行为识别和预测的启发,本文将行为和交互的观察比值作为性能量化指标。该评价指标以不同的观测视频/动作比值(0,0.1,0.2,…,1)采样,进行视频的定位和预测。预测任务的准确性类似于分类和识别,对于未修剪的视频,预测精度的评估难度较大。为此,首先将预测结果作为观测比值函数的真实视频行动,该操作相当于修剪情况。其次使用动作/交互的平均持续时间,通过在每个视频中每5帧滑动一个窗口提取时间上重叠的剪辑,其中,一些包含真实动作,另一些则代表未修剪视频的背景部分。最后将计算预测精度作为函数的观测比值。这种方法可以捕捉误报,并为未修剪的视频提供更全面的评估。

3.3 实验结果

在实验部分,本文以连续3帧为例,通过学习前两帧的行为特征估计下一帧的8个关节点的运动类型发生的概率,根据8个关节点运动类型的加权后得到行人下一帧的运动类型。

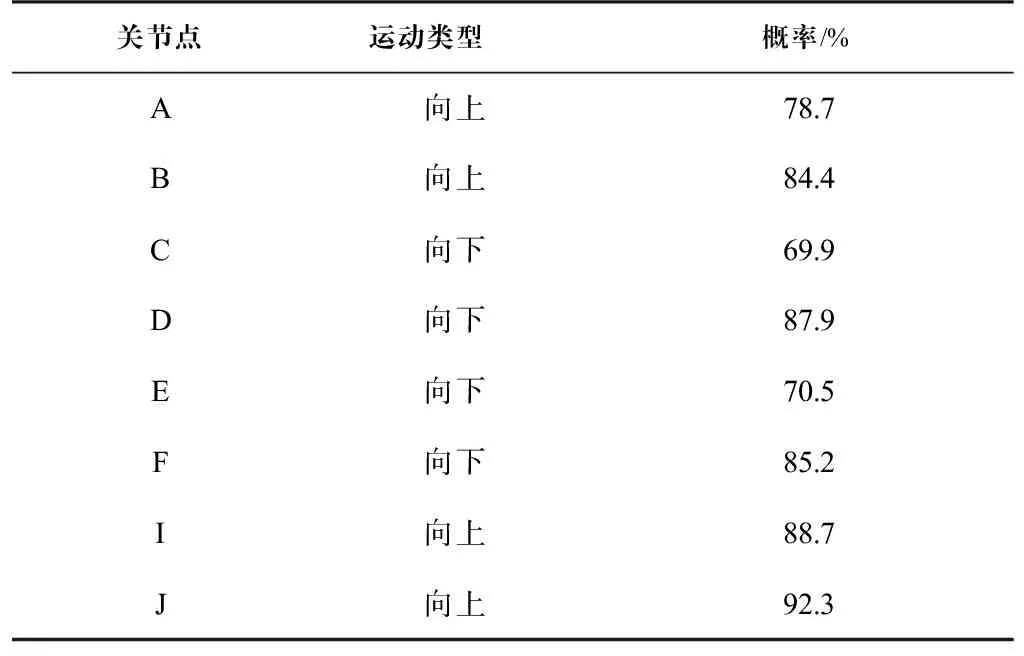

通过上述方法可以计算出8个关节点的运动类型发生的概率,结果如表1所示。从表1中可以推测出,行人的左臂在下一帧向上运动,行人的右臂在下一帧向下运动,行人的左腿在下一帧向下运动,行人的右腿在下一帧向上运动。根据划分网格特征判断行人向前匀速运动,其中左右手臂和左右腿的运动方向也是向前运动。

表 1 关节点运动类型及概率Tab.1 Type and probability of joint movement

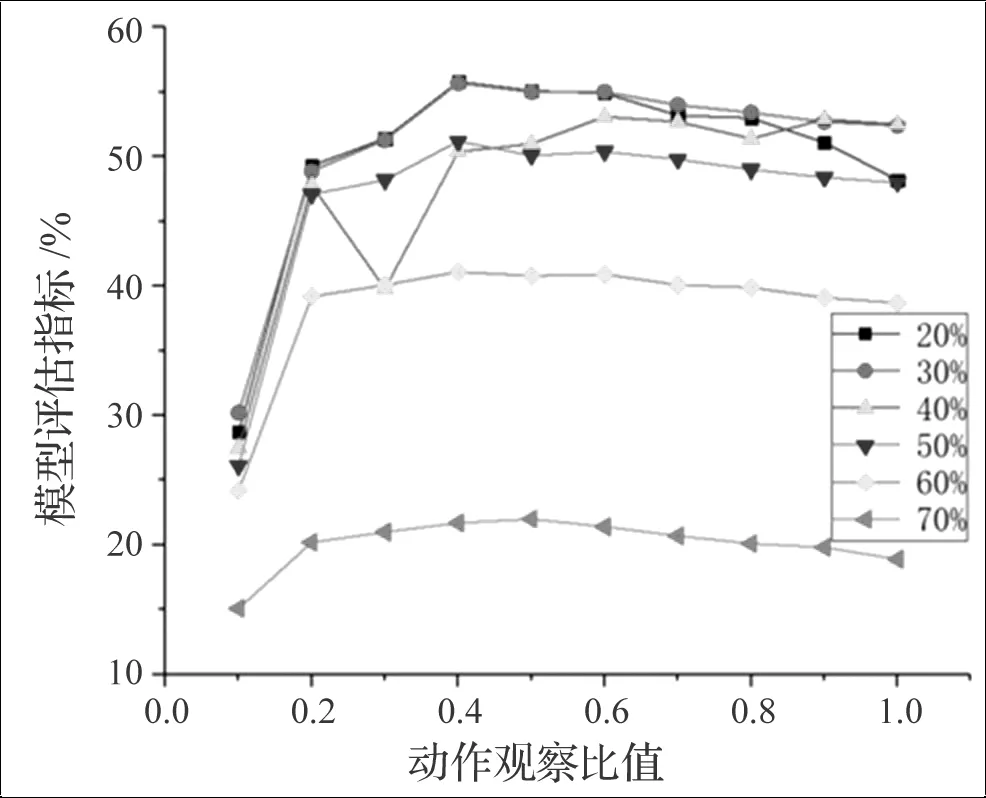

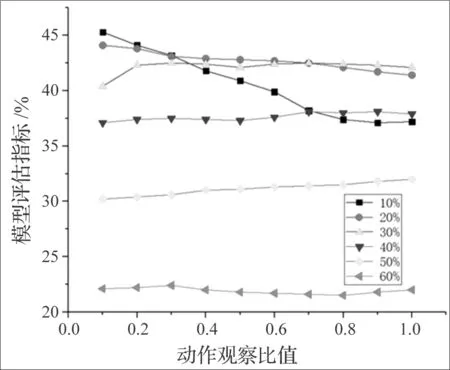

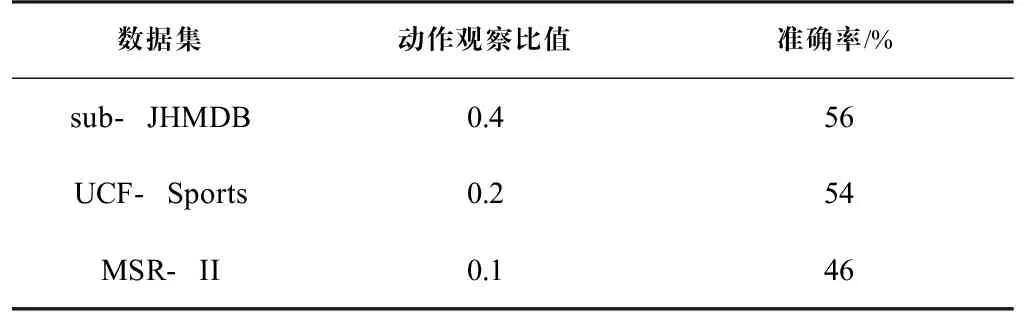

研究人员在3个行人动作数据集sub-JHMDB、UCF-Sports、MSR-II上验证在不同观察比值情况下不同重叠率的动作预测准确率。具体实验结果如图5至图7所示。其中,当动作观察比值为0.4、重叠率为30%时,在sub-JHMDB数据集上的准确率能达到56%;当动作观察比值为0.2、重叠率为10%时,在UCF-Sports数据集上的准确率能达到54%;当动作观察比值为0.1、重叠率为10%时,在MSR-Ⅱ数据集上的准确率能达到46%,不同数据集上最大准确率和动作观察比值见表2。

图5 不同观察比值在sub-JHMDB数据集上的准确率Fig.5 The accuracy of different observation ratios on sub-JHMDB dataset

图6 不同观察比值在UCF-Sports数据集上的准确率Fig.6 The accuracy of different observation ratios on UCF-Sports dataset

图7 不同观察比值在MSR-II数据集上的准确率Fig.7 The accuracy of different observation ratios on MSR-II dataset

表 2 不同数据集上最大准确率和动作观察比值Tab.2 Maximum accuracy and action observation ratios on different datasets

本研究以累积的方式计算AUC,50%的准确率意味着从一开始就定位一个动作,直到观察到视频的一半。这可以深入了解本文所提模型性能是如何随着时间或测试视频中观察到的比值的变化而变化的。从图5至图7可以看出,在视频开始播放时,定位一个动作是很有挑战性的,因为算法并没有观察到足够的判别运动用于区分不同的动作。此外,本研究首先从行人骨架姿态中学习外观模型,并随着时间的推移不断进行改进和细化。这提高了基于划分网格特征的外观可信度,进而提高了预测的准确性,稳定了AUC。

本文提出一种新的基于网格划分骨骼的行为预测方法,该方法主要分为两个部分,首先使用自下而上的方法提取行人的骨骼信息,规定左右肘、左右手、左右膝以及左右脚8个关节点作为提取行为习惯的关节点,并且通过学习8个关节点的距离度量特征和角度度量特征提取行人的行为特征。对8个关节点分别对比前后帧的行为特征,判断下一帧单个关节点运动类型发生的概率,通过对下一帧8个关节点运动类型的加权判断下一帧行人的动作。其次为了更好地评估行人下一帧的动作,本文通过对行人进行网格划分并提取相应关节点的划分网格特征,对比前后帧的划分网格特征,判断行人的运动方向及运动速度。实验结果验证了该方法的有效性。

猜你喜欢关节点度量骨骼鲍文慧《度量空间之一》上海文化(文化研究)(2022年3期)2022-06-28模糊度量空间的强嵌入数学年刊A辑(中文版)(2022年4期)2022-02-16做家务的女性骨骼更强壮中老年保健(2021年5期)2021-12-02三减三健全民行动——健康骨骼中老年保健(2021年5期)2021-08-24基于深度学习和视觉检测的地铁违规行为预警系统研究与应用科学技术创新(2021年19期)2021-07-16关节点连接历史图与卷积神经网络结合的双人交互动作识别沈阳航空航天大学学报(2020年6期)2021-01-27迷向表示分为6个不可约直和的旗流形上不变爱因斯坦度量数学年刊A辑(中文版)(2019年3期)2019-10-08骨骼和肌肉小布老虎(2017年1期)2017-07-18搞好新形势下军营美术活动需把握的关节点军营文化天地(2017年6期)2017-06-28RGBD人体行为识别中的自适应特征选择方法智能系统学报(2017年1期)2017-06-01